Après le lancement de Mistral Vibe 2.0, la start-up française Mistral AI a dévoilé Voxtral Transcribe 2, une famille de deux modèles de transcription audio conçus pour répondre aux besoins des entreprises. L'argument coup de poing de cette offre ? Des performances comparables aux géants du secteur comme OpenAI, Google ou Amazon, mais pour un cinquième du prix. Disponibles dès aujourd'hui, ces modèles s'inscrivent dans la stratégie d'expansion de Mistral sur le marché de l'IA vocale, un domaine jusqu'ici dominé par les acteurs américains.

Ce qu'il faut retenir :

- Mistral AI propose deux modèles de transcription : Voxtral Mini Transcribe V2 pour le traitement par lots et Voxtral Realtime pour la transcription en temps réel

- Les deux modèles supportent 13 langues avec un taux d'erreur d'environ 4%, soit le meilleur rapport qualité-prix du marché (0,003 $/min pour Mini et 0,006 $/min pour Realtime)

- Voxtral Realtime offre une latence configurable jusqu'à moins de 200 ms et peut fonctionner en local sur smartphone ou ordinateur grâce à ses 4 milliards de paramètres

- Les performances surpassent GPT-4o mini Transcribe et Gemini 2.5 Flash tout en étant cinq fois moins cher que les solutions concurrentes

Voxtral Mini Transcribe V2 : de la puissance au service des gros volumes

Le premier modèle, Voxtral Mini Transcribe V2, se positionne comme la solution idéale pour transcrire de gros volumes de fichiers audio en une seule fois. Il embarque des fonctionnalités avancées comme le découpage selon les intervenants (diarisation), le biais contextuel et un horodatage précis au niveau des mots. Sa capacité impressionnante : traiter des enregistrements jusqu'à 3 heures en une seule requête.

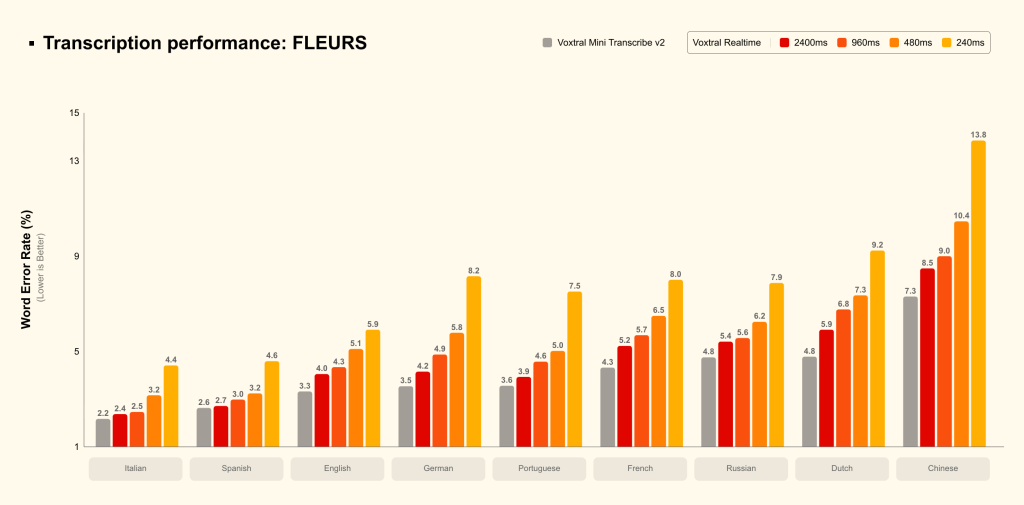

Compatible avec 13 langues (anglais, chinois, hindi, espagnol, arabe, français, portugais, russe, allemand, japonais, coréen, italien et néerlandais), ce modèle affiche un taux d'erreur d'environ 4%. En termes de rapidité, il traite l'audio environ trois fois plus vite que Scribe v2 d'ElevenLabs, tout en proposant une qualité équivalente. Mistral revendique des performances supérieures à GPT-4o mini Transcribe, Gemini 2.5 Flash, Assembly Universal et Deepgram Nova.

Le tarif de 0,003 dollar par minute fait de Voxtral Mini Transcribe V2 le modèle au meilleur rapport qualité-prix du marché selon Mistral AI. Pour les entreprises qui doivent traiter quotidiennement de gros lots de fichiers audio (interviews, réunions, podcasts), cette solution représente une alternative économique sans compromis sur la qualité.

Voxtral Realtime : la transcription instantanée accessible en local

Le second modèle, Voxtral Realtime, a été spécifiquement conçu pour la transcription en direct. Son principal avantage réside dans sa latence ultra-faible, configurable jusqu'à moins de 200 ms, ce qui permet des applications en temps réel comme le sous-titrage en direct ou les agents vocaux conversationnels.

Avec seulement 4 milliards de paramètres, Voxtral Realtime est suffisamment compact pour fonctionner localement sur un smartphone ou un ordinateur, sans connexion cloud permanente. Cette caractéristique ouvre des perspectives intéressantes pour les applications nécessitant confidentialité et sécurité des données. Le modèle est d'ailleurs disponible en open-weights sous licence Apache 2.0, permettant aux développeurs de l'intégrer librement dans leurs projets.

Les tests de Mistral montrent qu'avec un délai de 2,4 secondes (optimal pour le sous-titrage), Realtime égale les performances de son modèle de traitement par lots. Même avec une latence réduite à 480 ms, le taux d'erreur reste inférieur à 1-2%, garantissant une précision quasi-équivalente au traitement différé. Cette performance surpasse la solution de Google qui affiche une latence d'environ 2 secondes.

Facturé 0,006 dollar par minute via API, Voxtral Realtime peut aussi être testé gratuitement dans Mistral Studio ou via le chatbot Le Chat, facilitant son adoption par les développeurs.

Un positionnement stratégique sur l'IA vocale

Avec cette double annonce, Mistral AI prouve sa capacité à concurrencer les géants technologiques sur des segments jusqu'ici dominés par Amazon, Google, Microsoft et OpenAI. L'approche française se distingue par son modèle économique agressif : des performances comparables pour un coût divisé par cinq.

La start-up parisienne multiplie les lancements stratégiques. Quelques jours avant cette annonce, elle avait dévoilé Vibe 2.0, son agent de codage optimisé, confirmant sa volonté de couvrir l'ensemble de la chaîne de valeur de l'IA générative. Le support de 13 langues, incluant des langues non-européennes comme le chinois, l'hindi, l'arabe, le japonais et le coréen, témoigne d'une ambition mondiale.

Pour faciliter l'adoption, Mistral a mis en place un espace de test audio dans Mistral AI Studio, permettant aux utilisateurs de tester instantanément les capacités de transcription avec diarisation et horodatages. Cette stratégie d'accessibilité, combinée à la publication en open-weights de Voxtral Realtime, pourrait accélérer la diffusion de ces technologies dans l'écosystème français et européen de l'IA.