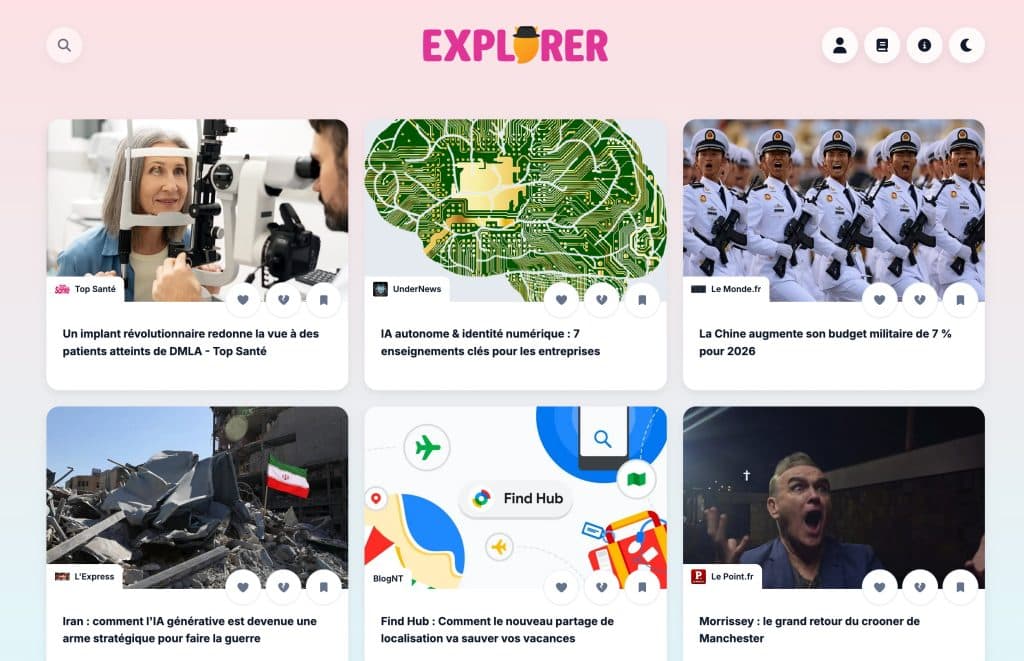

Un peu plus d’un an après l’annonce d’Ibou, la première brique visible arrive enfin : Ibou Explorer, un flux de contenus personnalisés qui rappelle Google Discover… mais sans en copier la logique ni les objectifs.

Avec cette bêta, le projet mené par Sylvain Peyronnet (Babbar, YourTextGuru) et son équipe commence à montrer comment sa vision d’un web plus qualitatif et plus transparent peut se traduire dans un produit concret. Quelques mois après un premier article consacré au moteur le plus « chouette » du web, on s’est entretenu avec le chef d’orchestre du projet Ibou pour en savoir plus sur cette fonctionnalité et les prochaines étapes !

Explorer : un Discover à la sauce Ibou

« Explorer n’est pas Ibou de la même manière que Discover n’est pas Google ! En revanche, de toutes les briques sur lesquelles on bosse en parallèle, c'est la première terminée. »

Dans le projet Ibou, Explorer n’est pas le moteur de recherche lui‑même, mais une verticale B2C dédiée à la recommandation d’articles « de divertissement au sens noble », personnalisés selon les goûts de chaque utilisateur. L’idée : proposer chaque jour des contenus sympas, qualitatifs et variés, sans se limiter à ce que l’utilisateur lit déjà en boucle.

Ibou Explorer se rapproche donc de Google Discover dans son principe (un flux de contenus recommandés), mais avec deux différences importantes :

- Une sélection stricte des sources et des thèmes, pour éviter les contenus problématiques ou très peu qualitatifs, conformément au manifeste d’Ibou ;

- Une volonté affirmée de casser les bulles de filtres, en introduisant volontairement des contenus hors « zone de confort », mais susceptibles de plaire.

La personnalisation s’appuie à la fois sur ce que l’utilisateur déclare aimer et sur son comportement : articles vus, appréciés, ignorés, temps passé, clics courts ou longs, etc. Chaque visiteur d’Ibou peut ainsi voir un flux très différent, même si la base de contenus reste la même.

« Explorer est d’abord un outil d’accès à des contenus de divertissement personnalisés selon les goûts de l’utilisateur. L’objectif n’est pas de donner uniquement des contenus qui correspondent à ce qu’une personne lit tout le temps, mais bien de proposer des choses sympas et qualitatives. »

Comment Ibou Explorer choisit ce qu’il met en avant

Derrière son interface simple, Explorer repose sur une chaîne de traitement assez sophistiquée, que l’équipe a commencé à détailler sur son Substack dédié à la transparence algorithmique.

1. Qualité minimale et éligibilité

Premier filtre : tous les contenus du web ne sont pas éligibles. Ibou se concentre sur les sites qui atteignent une « qualité moyenne raisonnable », en cohérence avec les valeurs affichées dans son manifeste.

Concrètement, cela implique :

- Un site techniquement correct :

- Performances raisonnables,

- Pas de clutter excessif,

- Un comportement acceptable côté UX (CLS, temps de chargement, etc.) ;

- Des pages qui respectent certains standards éditoriaux :

- Titres non abusifs,

- Images adaptées pour l’aperçu,

- Contenu suffisamment travaillé.

Une fois cette barre franchie, un site peut entrer dans le périmètre Explorer, mais cela ne garantit pas qu’il sera pour autant souvent mis en avant : les articles doivent ensuite être en phase avec des attentes et des centres d’intérêt réels à un moment donné.

2. Scorage des contenus : risque, qualité, engagement

Les contenus éligibles font ensuite l’objet d’un scorage qui combine plusieurs dimensions :

- Un niveau de qualité éditoriale (rédaction, structure, richesse du propos, sources citées, etc.) ;

- Un score de risque, inspiré de la logique YMYL : Un article portant sur un sujet médical ou financier sensible doit passer une barre beaucoup plus haute qu’un billet à la thématique légère ;

- Un potentiel d’engagement humain : la probabilité que l’article plaise et soit réellement lu.

L’équipe explique également travailler sur un filtre spécifique visant à pénaliser « les contenus mal faits avec de l’IA » : pas un détecteur IA pur, mais un système qui cherche à distinguer un contenu réellement travaillé (humain ou IA bien encadrée) d’un « gloubi‑boulga » généré en quelques secondes sans sources ni expérience réelle.

3. Personnalisation et signaux comportementaux

Une fois les contenus scorés, Explorer les met en face des profils utilisateurs :

- Préférences explicites (thèmes choisis, centres d’intérêt) ;

- Historique d’articles vus et appréciés ;

- Signaux comportementaux globaux (CTR, clics courts / longs, last clicks, etc.).

Un score final mélange ces signaux contenus + les signaux utilisateurs pour décider, en temps réel, quels articles proposer à chaque visiteur. Un mécanisme supplémentaire introduit de la diversité pour casser les bulles de filtres, point sur lequel l’équipe dit passer beaucoup de temps à régler les bons paramètres.

« Un mécanisme supplémentaire va permettre de créer de la diversité pour casser les bulles de filtres, les utilisateurs de la beta ont sans doute pu constater que c’est un sujet sur lequel on travaille beaucoup pour trouver les bons paramètres. »

Mimesis : le ranking du moteur de recherche Ibou

Comme dit précédemment, Explorer n’est qu’une brique : Ibou reste d’abord un moteur de recherche, impliquant un vrai travail de retrieval et de ranking à grande échelle. Dans un article publié en janvier 2026, Sylvain Peyronnet introduit Mimesis, l’algorithme de ranking maison qui doit permettre à Ibou de classer les résultats sans compter sur les milliards de clics de Google.

Retrieval vs ranking : le rappel et la précision

L’article rappelle la distinction classique entre :

- Le retrieval, qui vise à maximiser le rappel : retrouver tous les documents potentiellement utiles dans un index massif ;

- Le ranking, qui maximise la précision : classer ces documents pour que les meilleurs remontent dans les premières positions.

Dans l’analogie proposée, le retrieval correspond au bibliothécaire qui ramène une centaine de livres sur les loutres ; le ranking, c’est le tri opéré par l’humain qui élimine les ouvrages douteux, privilégie les éditeurs de référence et les auteurs reconnus, puis ordonne la pile pour lire d’abord les sources les plus fiables.

Composer sans NavBoost : comment apprendre à classer sans milliards de clics ?

Google s’appuie sur des briques de type NavBoost, qui enregistrent les clics, les durées de visite et les reformulations de requêtes sur des milliards d’utilisateurs, afin d’alimenter des algorithmes de learning‑to‑rank. Retirer cette brique a d’ailleurs été reconnu comme ayant un « impact négatif significatif » sur la qualité des résultats lors du procès antitrust du géant américain.

Ibou ne dispose évidemment pas d’un tel historique. La solution retenue : utiliser les LLMs comme juges, dans une approche dite LLM‑as‑a‑Judge. Des modèles de langage annotent massivement des couples requête / document en évaluant, comme le ferait un humain :

- La légitimité de la source ;

- L’expertise perçue ;

- La complétude de la réponse ;

- Le style ;

- La présence de signaux suspects (contenu creux, sur‑optimisé, etc.).

Ces annotations servent « d’oracle de vérité » pour entraîner Mimesis, qui devient alors capable d’apprendre des règles contextuelles et non linéaires sur des centaines de millions de documents. L’architecture est conçue pour rester rapide, explicable, sobre en ressources et stable d’une version à l’autre.

Des centaines de signaux, un focus sur le risque

Mimesis exploite aujourd’hui près d’une centaine de signaux par document candidat, dont l’équipe donne quelques exemples :

- Signaux d’autorité : version maison du BAS, diversité des backlinks (IP, AS distincts), trust, etc. ;

- Signaux d’expertise : qualité éditoriale, présence de sources, scores type EEAT ;

- Signaux de risque : plusieurs scores qui adaptent le niveau d’exigence selon la sensibilité du sujet ;

- Signaux sémantiques : correspondance requête / document, combinant approches lexicales classiques et modèles neuronaux ;

- Signaux éditoriaux : écriture, structure, effort réel ;

- Signaux d’engagement potentiel.

Les premiers tests internes annoncés montrent :

- Un streak (suite de résultats pertinents avant de tomber sur un mauvais) 22 % supérieur aux autres approches testées ;

- Sur des requêtes critiques (YMYL, etc.) :

- +21 % de précision sur le premier résultat,

- +37 % sur les trois premiers,

- +43 % de bons résultats supplémentaires trouvés dans le top 3.

L’équipe insiste : ces chiffres comparent Mimesis à une baseline interne, pas encore aux autres moteurs du marché.

Explorer et SEO : comment apparaître, et à quelles conditions ?

Pour les éditeurs et les SEO, la question est évidente : que faut‑il travailler pour espérer apparaître dans Ibou Explorer, à l’heure où le trafic provenant de Google Discover reste très convoité… et très opaque ?

Les critères évoqués par Ibou

Sylvain Peyronnet résume ce qui compte aujourd’hui pour Explorer :

- Critères techniques :

- Images qui fonctionnent bien pour des aperçus propres,

- Titres non abusifs en taille,

- Site raisonnablement performant (un site très lent ou très encombré peut être dépriorisé) ;

- Un sitemap ou un flux RSS bien fait ;

- Signaux de qualité :

- Articles réellement qualitatifs par rapport au sujet,

- Sourcing sérieux,

- Rédaction claire et travaillée,

- Pas de remplissage automatisé ;

A noter qu’il s’agit d’un produit B2C qui veut montrer de la qualité sans « blesser » les utilisateurs. Certains sujets sensibles ont donc peu de chances de passer. Ibou a également la volonté de ne pas mettre en avant de fake news.

« Concernant les signaux eux-mêmes, tout est orienté sur la qualité. Il faut donc des articles réellement qualitatifs (relativement au sujet), que ce soit sur le sourcing, la qualité rédactionnelle, etc. »

Autrement dit : un site qui travaille déjà correctement ses contenus, son UX et sa technique n’a pas besoin d’optimisations « Ibou‑spécifiques » pour devenir éligible. La sélection se joue ensuite sur la pertinence contextuelle et la capacité à publier sur des sujets qui comptent vraiment pour une audience.

Ibou veut renvoyer du trafic, pas le garder

Dans un contexte où les résumés IA et les pages de résultats enrichies limitent de plus en plus les clics sortants, Ibou assume son positionnement : l’objectif est de renvoyer les utilisateurs vers les sites de qualité, pas de les enfermer dans une interface.

Ibou se présente d’ailleurs comme un moteur de réponses agentique qui mettra en avant ses sources et s’inscrit dans une logique de web meilleur, plus respectueux des éditeurs :

- En faisant remonter les contenus de qualité,

- En refusant de jouer la massification du contenu médiocre,

- En assumant une transparence accrue sur les algorithmes via le Substack et le manifeste.

« Ibou a pour mission de contribuer à un meilleur web, respectueux des éditeurs de sites de qualité. On veut donc envoyer les gens vers les sources, pour que ce web de qualité perdure. »

Et après ? Béta publique, Search et Images !

Côté feuille de route, la bêta actuelle n’est évidemment qu’une étape :

- Une bêta publique d’Explorer doit suivre, avec des fonctionnalités absentes de la bêta privée, notamment la recherche dans l’index d’Explorer pour suivre une actualité ou explorer un événement précis ;

- Le prochain gros rendez‑vous annoncé concerne le moteur d’images, avec des cas d’usage envisagés pour le shopping ;

- En parallèle, le moteur de Search conversationnel continue d’avancer, avec Mimesis au centre du ranking et un travail continu sur le crawl (IbouBot), le retrieval et la qualité de l’index.

« On n’est qu’au début mais pour l’instant tout est comme on le voulait, pourvu que ça dure ! »

Un grand merci à Sylvain Peyronnet pour avoir pris de son temps précieux pour répondre à nos questions !