En une seule journée, la startup parisienne a dévoilé trois annonces majeures qui confirment son ambition de devenir une brique incontournable de l'infrastructure IA mondiale. Voici ce que ça change concrètement.

Ce qu'il faut retenir :

- Mistral Small 4 unifie pour la première fois raisonnement, multimodal et code agentique dans un seul modèle, sous licence Apache 2.0.

- Mistral rejoint la coalition Nemotron de NVIDIA comme membre fondateur, aux côtés de Perplexity, Cursor et Black Forest Labs.

- Leanstral est le premier agent open source capable de générer des preuves formelles de code pour Lean 4, avec un rapport coût/performance revendiqué jusqu'à 15 fois supérieur aux concurrents généralistes.

- Ces trois annonces dessinent un repositionnement stratégique : Mistral ne se présente plus comme une alternative nationale, mais comme un acteur mondial de référence.

Small 4 : un modèle qui remplace trois déploiements

Jusqu'ici, les équipes techniques qui voulaient exploiter les modèles Mistral devaient choisir entre plusieurs outils spécialisés : Magistral pour le raisonnement, Pixtral pour le traitement d'images, Devstral pour le code agentique. Mistral Small 4 met fin à cette fragmentation.

Le modèle repose sur une architecture Mixture of Experts (MoE) : 119 milliards de paramètres au total, mais seulement 6 milliards actifs par requête. Ce fonctionnement permet de conserver une grande capacité globale tout en limitant le coût computationnel à chaque inférence. Par rapport à Mistral Small 3, la startup annonce 40 % de réduction de latence et trois fois plus de requêtes par seconde dans une configuration optimisée pour le débit.

La fenêtre de contexte atteint 256 000 tokens, ce qui permet de traiter des documents longs sans avoir à les découper. Le modèle accepte aussi bien le texte que les images en entrée.

L'ajout le plus notable pour les usages professionnels est le paramètre reasoning_effort. Il permet à l'utilisateur de choisir entre une réponse rapide et légère, équivalente au comportement de Small 3, et une analyse approfondie, étape par étape, comparable aux anciens modèles Magistral. Un seul déploiement couvre donc des besoins qui en nécessitaient trois auparavant.

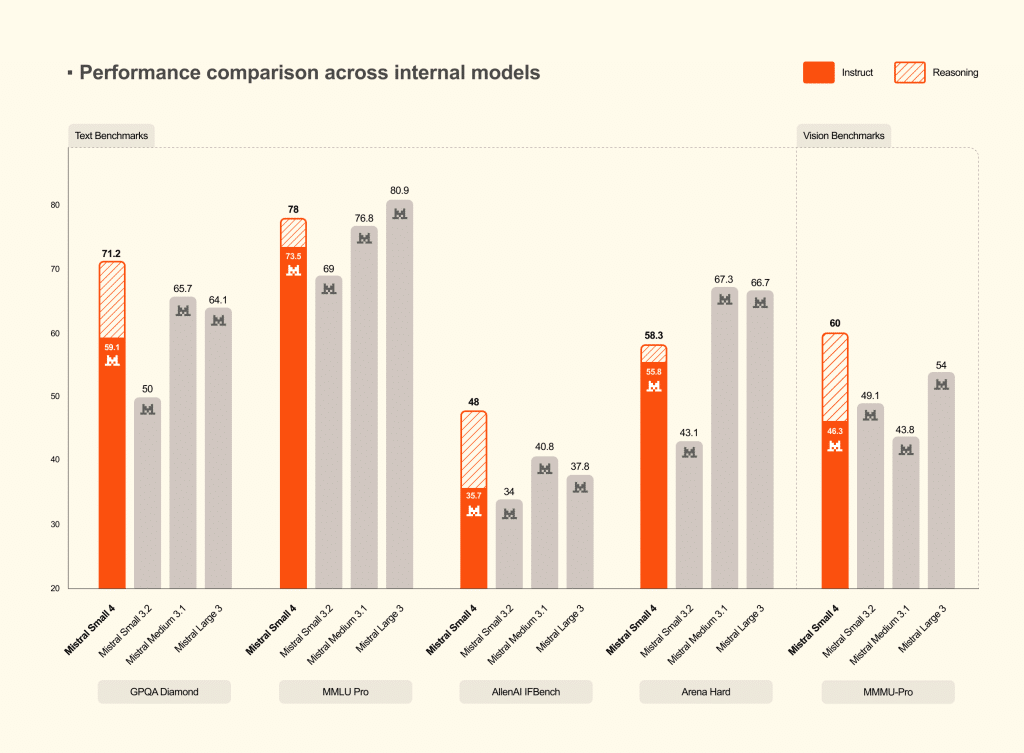

Sur les benchmarks, Mistral affirme que Small 4 avec raisonnement activé égale ou dépasse GPT-OSS 120B sur trois évaluations testées, tout en produisant des sorties significativement plus courtes. Des sorties plus courtes, c'est moins de latence, moins de coûts d'inférence et une meilleure expérience utilisateur en production.

Le modèle est disponible sur l'API Mistral, Hugging Face, et en tant que conteneur optimisé NVIDIA NIM pour les déploiements sur site. Il est publié sous licence Apache 2.0 et compatible avec les frameworks d'inférence courants : vLLM, llama.cpp, SGLang et Transformers.

La coalition Nemotron : Mistral s'installe à la table des grands

C'est probablement l'annonce la plus stratégique de la journée. Mistral rejoint la coalition Nemotron de NVIDIA comme membre fondateur, aux côtés de Cursor, Perplexity, Black Forest Labs et du laboratoire de Mira Murati.

L'objectif de cette coalition est de co-développer un modèle de base open source, Nemotron 4, entraîné sur le cloud DGX de NVIDIA. Le modèle sera ensuite publié en open source pour que l'ensemble de l'industrie puisse le spécialiser. Chaque membre apporte une expertise complémentaire : multilingue et architecture de modèle pour Mistral, recherche pour Perplexity, orchestration pour LangChain, multimodal pour Black Forest Labs.

Pour Mistral, cela signifie accéder à l'infrastructure de calcul de NVIDIA pour entraîner des modèles à une échelle qu'elle ne pourrait pas financer seule. En échange, la startup apporte ses techniques d'entraînement, ses capacités multimodales et ses outils de fine-tuning orientés entreprise.

La logique industrielle est claire. Face aux écosystèmes fermés d'OpenAI et Google, cette coalition structure le camp open source en force coordonnée. Pour NVIDIA, un modèle de référence optimisé pour ses puces renforce mécaniquement la demande en matériel.

Cette alliance n'est pas sans tension. Le cloud DGX sur lequel Nemotron 4 sera entraîné appartient à NVIDIA. Mistral l'a bien compris : l'entreprise investit en parallèle dans ses propres capacités de calcul, en France et en Suède, pour que ce partenariat reste un choix stratégique et non une dépendance contrainte. La question de la souveraineté technologique reste posée : Mistral renforce un lien avec un acteur américain soumis aux réglementations extraterritoriales des États-Unis.

Leanstral : quand l'IA prouve qu'elle a raison

La troisième annonce est la plus technique. Elle s'adresse à un public restreint aujourd'hui, mais touche un problème fondamental de l'IA agentique.

Le problème que Leanstral cherche à résoudre

Quand un agent IA génère du code aujourd'hui, le résultat est probabiliste. Le code a l'air correct, il passe les tests, mais aucune garantie absolue n'existe. La vérification repose sur des humains, qui relisent, testent et corrigent. Plus les agents produisent vite, plus ce goulot d'étranglement humain devient critique.

Il existe une solution à ce problème : la preuve formelle. Un assistant de preuve comme Lean 4 permet à un développeur d'écrire non seulement un programme, mais aussi sa démonstration mathématique. Si la démonstration est valide, le code est garanti correct, pas « probablement correct », pas « correct dans les cas testés », mais correct au sens mathématique du terme. Lean 4 sert déjà à des mathématiciens pour formaliser des preuves complexes, et à des ingénieurs pour certifier des logiciels critiques.

Le problème, c'est qu'écrire des preuves dans Lean 4 est un travail de spécialiste, lent et exigeant. C'est précisément le vide que Leanstral cherche à combler.

Ce que fait concrètement Leanstral

Leanstral est un agent IA de 6 milliards de paramètres actifs, entraîné spécifiquement pour générer des preuves formelles en Lean 4. Il ne se contente pas de produire du code : il génère la démonstration qui certifie ce code. Lean 4 vérifie ensuite cette démonstration. Si elle est invalide, elle est rejetée. Le vérificateur est incorruptible.

C'est le premier agent open source de ce type pour Lean 4. Les systèmes existants sont soit des surcouches autour de modèles généralistes, soit limités à des problèmes mathématiques isolés. Leanstral est conçu pour fonctionner dans des dépôts formels réels, avec une architecture sparse et une optimisation spécifique aux tâches de preuve.

Les benchmarks et leurs limites

Sur FLTEval, leur propre suite d'évaluation, Leanstral atteint un score de 26,3 pour 36 dollars (pass@2), contre 23,7 pour 549 dollars pour Claude Sonnet 4.6. À pass@16, Leanstral atteint 31,9, devançant Sonnet par 8 points. Claude Opus 4.6 reste le meilleur en qualité absolue avec un score de 39,6, mais à 1 650 dollars, soit 92 fois plus cher.

Ces chiffres méritent une lecture prudente. FLTEval est un benchmark maison, non reproduit par des tiers. La comparaison de coûts opposant un modèle spécialisé de 6 milliards de paramètres actifs à des modèles généralistes massifs n'est pas neutre : c'est un outil optimisé pour une tâche précise comparé à des couteaux suisses. La capacité de Leanstral à généraliser au-delà du projet mathématique FLT sur lequel il a été évalué reste à démontrer. Enfin, tous les tests ont été conduits dans l'environnement Mistral Vibe.

Pourquoi c'est important au-delà des mathématiques

Le vrai enjeu est celui de la confiance dans les agents autonomes. Aujourd'hui, un agent IA écrit du code et agit sur des données sans que chaque ligne soit vérifiée. Un agent capable de prouver formellement que son code fait exactement ce qu'on lui a demandé change la donne : l'humain spécifie le résultat attendu, la machine prouve qu'elle l'a produit. La supervision se déplace de la vérification ligne par ligne vers la définition de spécifications.

Leanstral est disponible immédiatement via Mistral Vibe (commande /leanstall), via une API gratuite (labs-leanstral-2603) et en téléchargement direct des poids sous licence Apache 2.0.

Un repositionnement stratégique assumé

Lues ensemble, ces trois annonces ne sont pas des sorties de produits isolées. Elles décrivent une trajectoire.

- Small 4 couvre le marché de l'entreprise avec un modèle polyvalent, performant et économe.

- La coalition Nemotron donne à Mistral une présence dans la définition des standards mondiaux de l'IA open source.

- Leanstral montre la profondeur d'une R&D qui va au-delà des modèles de chat.

Mistral vise le milliard d'euros de chiffre d'affaires cette année, construit un datacenter en Suède, a signé avec le ministère des Armées en janvier et a racheté Koyeb en février. Le tout en maintenant une politique open source cohérente avec la licence Apache 2.0. La question qui reste ouverte est celle de la soutenabilité : combien de temps une entreprise en hypercroissance peut-elle publier ses modèles gratuitement tout en finançant l'infrastructure colossale nécessaire pour les entraîner ?