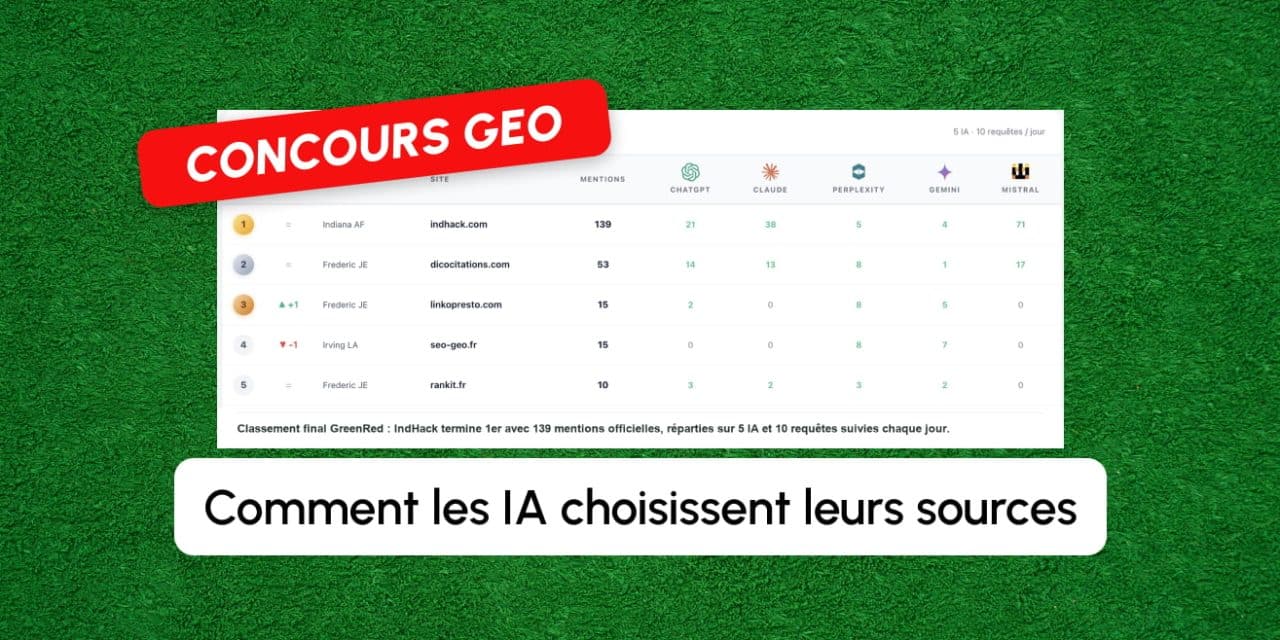

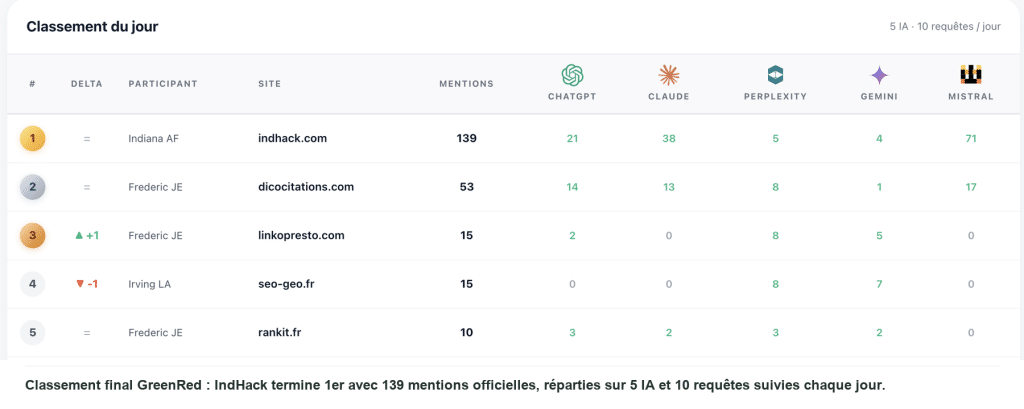

Du 16 mars au 17 avril 2026, GreenRed a organisé le premier concours GEO français. Le principe : faire émerger un mot inventé, « vultifrine », dans les réponses de cinq IA génératives. Chaque jour, dix requêtes liées à ce terme étaient testées sur ChatGPT, Claude, Mistral, Perplexity et Gemini.

Le classement ne portait pas sur des positions Google, mais sur les mentions de domaine dans les réponses. J’y ai participé avec IndHack, qui a terminé premier avec 139 mentions officielles : 71 sur Mistral, 38 sur Claude, 21 sur ChatGPT, 5 sur Perplexity et 4 sur Gemini.

Pourquoi le GEO intéresse déjà le SEO

Le GEO, pour Generative Engine Optimization, consiste à travailler sa présence dans les réponses produites par les IA. Le sujet monte parce que les usages changent : une partie des internautes ne cherche plus seulement une liste de liens, mais une réponse directe, synthétisée, souvent accompagnée de sources.

Pour une entreprise, l’enjeu est simple : si ChatGPT, Perplexity, Claude ou Gemini citent toujours les mêmes acteurs, ces sources gagnent une visibilité nouvelle. Le SEO ne disparaît pas, mais il s’élargit : il faut continuer à être visible sur Google, tout en devenant suffisamment clair et fiable pour être repris par les moteurs génératifs.

Un mot fictif, donc un terrain neutre

La vultifrine n’existait pas avant le concours. Il n’y avait pas de requêtes installées, pas d’articles anciens, pas de source déjà reconnue sur ce mot. Les IA devaient construire leur compréhension à partir des contenus publiés pendant le concours.

En tant que consultante SEO, ce cadre était intéressant : on ne cherchait pas seulement à savoir quelle page allait se positionner, mais quelle source allait devenir assez crédible pour être citée dans une réponse générée.

Les grandes lignes de la stratégie IndHack

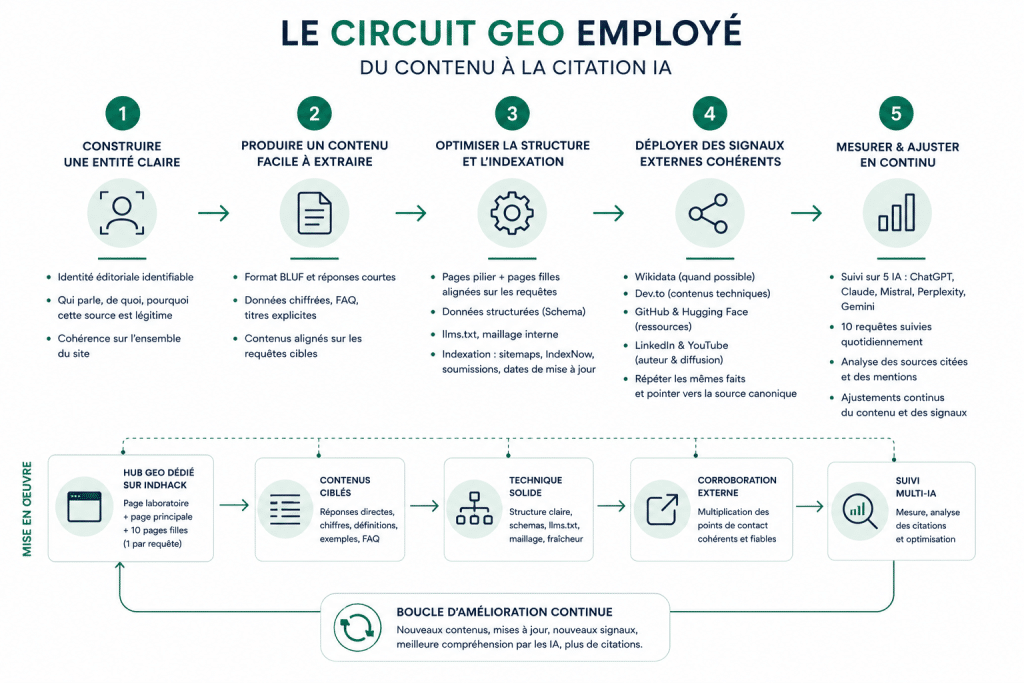

IndHack est d’abord mon site professionnel autour du SEO, du GEO et de la visibilité web. Pour le concours, j’ai créé à l’intérieur du site un hub GEO expérimental, clairement isolé du reste : une page laboratoire, une page principale sur la vultifrine et dix pages filles alignées avec les dix requêtes suivies.

L’objectif était de rendre le test lisible par les IA : une entité claire, des réponses courtes, des données chiffrées, des données structurées, un fichier llms.txt, du maillage interne, des mises à jour visibles et des signaux externes cohérents.

J’ai aussi travaillé l’indexation. Sur un mot inventé, une page pertinente mais non découverte ne sert à rien. Sitemaps, IndexNow, soumissions via Bing ou Google quand c’était possible, contrôle des dates de mise à jour : tout devait aider les moteurs à découvrir rapidement les contenus et à en comprendre la fraîcheur.

Ce que le concours a montré

Toutes les IA ne réagissent pas de la même manière. Perplexity capte vite les sources web et communautaires. ChatGPT dépend beaucoup de la qualité d’indexation et de la structure des pages.

Gemini reste très lié à l’écosystème Google. Claude demande une forte cohérence factuelle. Mistral capte très bien les contenus structurés, les FAQ et les blocs courts.

Ces observations ne sont pas des règles absolues, mais elles montrent qu’on ne peut pas mesurer la visibilité IA avec une seule requête, sur un seul moteur. Il faut regarder plusieurs IA, plusieurs formulations, et surtout les sources qu’elles choisissent réellement de citer.

TOP 5 des leviers qui font la différence

- Construire une entité claire. Une IA doit comprendre qui parle, de quoi, et pourquoi cette source est légitime. Dans mon cas, l’entité IndHack / Indiana Aflalo devait rester identifiable derrière les contenus.

- Rendre l’information facile à reprendre. Le format BLUF, qui donne la réponse essentielle en début de bloc, aide les IA à extraire une définition, un chiffre ou une explication sans perdre le contexte.

- Soigner l’indexation et la fraîcheur. Les contenus doivent être découverts vite, mis à jour et cohérents. Une bonne page que les moteurs ne voient pas à temps ne peut pas être citée.

- Créer des signaux externes cohérents. Le travail ne s’est pas limité au site : Wikidata quand c’était possible, Dev.to pour l’angle technique, GitHub et Hugging Face pour les ressources publiées, LinkedIn et YouTube pour les signaux d’auteur et de diffusion.

- Mesurer plusieurs moteurs. Un résultat sur ChatGPT ne suffit pas. Les IA n’ont pas les mêmes sources, les mêmes délais ni les mêmes réflexes de citation.

Ce que cela change pour un site web

Le référencement naturel reste la base. Mais la visibilité dans les IA renforce l’exigence : moins de pages floues, plus de faits, plus de structure, plus de fraîcheur et plus de cohérence entre le site, les données structurées et les signaux externes.

C’est aussi ce constat qui m’a poussée à créer un testeur de visibilité IA gratuit, afin d’aider les éditeurs à vérifier leurs premiers signaux de lisibilité. La conclusion du concours est nette : dans les réponses IA, la source qui gagne n’est pas forcément la plus ancienne, ni la plus puissante. C’est celle qui aide le mieux la machine à produire une réponse fiable, claire et attribuable.